A/Bテストを始める時に気になるのが、「テスト結果が出るまでに、どれだけの期間がかかるか?」このテスト期間を判断するのが実は難しい理由と、その場合の代替案を、簡単な統計学の観点から具体的なケースを交えて解説します。

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら

目次

ストップする時期は、どうやって判断すればよい?

A/Bテストを始める時に、関係者からよくいただくご質問が「どれくらいの期間で、結果が出ますか?」です。

A/Bテストでも、チラシやメールといった一括で配信するタイプであれば、期間はコントロールできず、逆にあまり気にする必要はないでしょう。

一方、LP(ランディングページ)や広告などオンラインのテストでは、よく論点になるのが「いつテストをストップするか?」です。

良い結果についてはテスト版を全面的に適用して、逆に結果が悪ければ元に戻す必要があるからです。

ところが統計学の観点からは、期間については一概には判断できません。

「1ヶ月間をみれば結果が出る」「最低2週間は必要」といったことは言えないのです。

逆に言えば、3日間で統計的に有意なテスト結果が出ることもあれば、1ヶ月以上かかっても十分な差がつかないケースもあります。

なぜ、テスト開始前には必要な期間が分からないのでしょうか?

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら

テスト結果を見誤らせる、「誤差」の正体

実は、「A/Bテストの結果が、統計的に信頼できるか?」を左右するのは、「サンプル数」と「各パターンの結果の差」の2つです。

(参考:「A/Bテストの結果をどのように解釈するか?」)

前提として、「A/Bテストの結果が出た」とは、どのような状態なのでしょうか?

A/Bテストを始めたばかりの頃は、最終的な結果とは逆の数字が出ていることがあります。これはアクセスしたユーザーの数、つまりサンプル数が少ないために「誤差」に左右されてしまいやすいからです。

「誤差」とは、「実際に得られた値が、本来の値からどれだけずれているかを表す量」のこと。

サンプル数が少ないと「1人の顧客が反応したか?しなかったか?」「たまたま途中で心変わりした」といった些細なできごとが、テスト結果に影響を与えてしまうのです。

(参考:「なぜ間違ったA/Bテストを信じてしまうのか?統計学から見た「誤差」の正体」)

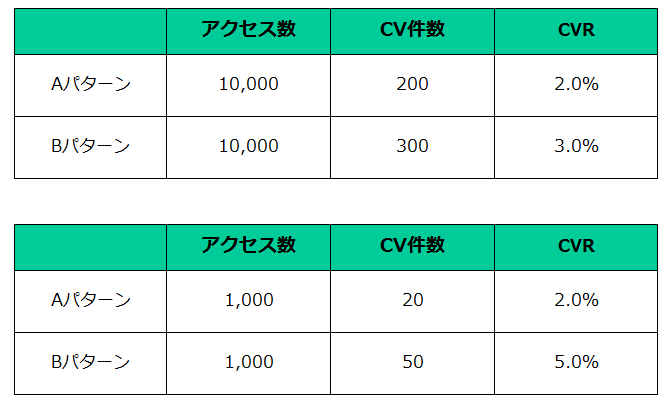

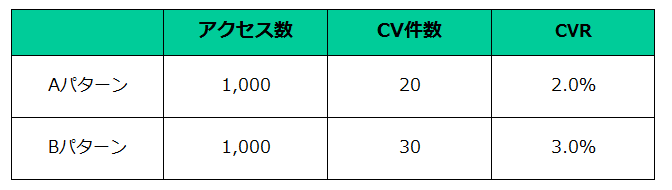

仮にWEBサイトのA/Bテストで次のような結果が出ていたとしましょう。

実はこの結果、統計学の観点から計算をすると誤差の影響が大きいと予想される、つまり統計的には「テスト結果が出た」とは言えないのです。

テスト1

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら

統計的にも信頼できるか?は、有意差で判断

では、どうなれば統計的に正しい結果が出たと言えるでしょう。

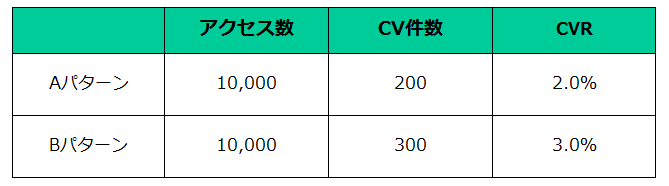

次のテスト2では、AパターンはCVRが2%でBパターンは3%と、ここまでは先ほどの数字と同じです。

ただし、アクセス数が10,000にと10倍に増加。

CV件数もそれぞれ、200件と300件に増えています。

テスト2

この場合、「テスト結果は出た」と判断できます。

その理由はリンク先の記事にてご覧になれますが、サンプル数(アクセス数)が増えると、その分誤差の影響する度合いが低くなって、統計的にも十分に信頼できるデータと判断できるのです。

このように統計的に信頼できる結果が出ていることを、「有意」である、「有意差」が付いていると言います。

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら

有意差がつくかは、「サンプル数」と「結果の差」で決まる

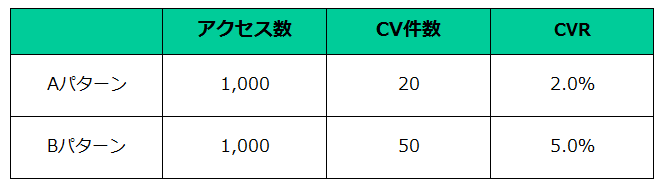

同じように、今度はテスト1からCV件数を変化させてみましょう。

アクセス数はそれぞれ同じですが、BパターンのCV件数が50件に増加、それにともなってCVRも5.0%になっています。

テスト3

この場合も、有意差がついていると言えます。

なぜなら、CV件数の差がテスト1と比べて大きく異なっているため、1,000件のアクセス数しかなくても、十分に差がついていると判断できるからです。

お気付きのことと思いますが、これまで説明したケースでは、「差がつくまでにどれだけの期間がかかったか?」は考慮されていません。

したがって、テスト2の結果がたとえ3日間で出た数値だとしても、あるいはここまで差がつくのには1ヶ月間がかかったとしても、統計的には特に違いがありません。

つまり、有意差がつくかは、「サンプル数」と「結果の差」で決まるのです。

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら

実務のうえで押さえておきたい、3つの方法

とはいっても、テスト期間が目安でも予測できないと、実務のうえでは困ったことも出てくるでしょう。そんな時には、どうすれば良いでしょう?

過去データにもとづいてシミュレーション

まずはテストの実施前に、アクセス数とCV件数の差に沿って、シミュレーションをしてみましょう。

アクセスについては、一定の期間で「だいたいこれくらい集まる」と予測できるはずです。

またテストの経験を積むようになると、「このテストなら、良くても悪くても差はこれくらいの範囲」などと目処が立つこともあるでしょう。

それぞれについて、アバウトな数値や過去のテストでかかった期間から、「いつ頃までにテスト結果が出るか?」を予想してみるとよいでしょう。

有意差の判定には、たとえばこちらのような信頼度の判定ツールがWEB上で無料で公開されているので、活用してみてもよいかもしれません。

途中でストップする基準を設ける

またせっかくテストをしても、仮説どおりに改善ができていないと、コンバージョンに差がつかないこともあります。

時間だけがいたずらに経っても有意差はつかずに、有効なテスト結果が出ていません。

テスト期間が長くなればなるほど、その間に外部環境も変わってしまい、データの質も信頼できなくなってしまう場合もあるでしょう。

それでは困るので、自分たちなりに基準を設けるとよいでしょう。

たとえば、「2ヶ月間が経っても有意差が付かない場合は、ほとんど差がないと判断して、テストをストップする」などの基準を設けてもよいでしょう。

信頼度の低いデータで見切り発車

これまで説明した有意差は、「信頼度95%」という一般的な指標に沿っています。

つまり「95%以上の確率で正しい」、逆に言えば「5%以下の確率で間違っている」という基準です。

この「95%」は、テストの方針や企業の考え方によって、別の数字でも構いません。

たとえば「90%の水準での有意差」という場合は、「90%以上の可能性で正しい」という意味です。

「95%」と比べると正確性には劣りますが、その分テストの結果が早く出るのがメリットです。

「スピード」と「正確性」どちらを重視するか?で、用いる基準を取捨選択していけば良いのです

これらの3つの考え方には、統計学の世界のように「正解」がある訳ではありません。

求める改善スピードや正確性にしたがって、自分たちなりに判断していきましょう。

つまり、「決め」が大事です。

A/Bテストに適切な期間の目安を立てられ、成果の改善につながる結果が出るように、そしてこの記事が役立つように祈っております。

売れる記事型広告の作り方を4つのステップに分けて解説しました。

PDCAの回し方や、LP遷移率アップの方法などをまとめています。

⇒解説資料はこちら